Rekrutacja: start! Ruszyły zapisy na rok akademicki 2026/2027 w PJATK!

Mark Zuckerberg – CEO Meta, zapowiedział istotne zmiany w moderacji treści publikowanych na Facebooku, Instagramie czy Threads. Platforma ta w zasadzie chciałaby zrezygnować z oficjalnych oznaczeń fałszywych informacji, weryfikowanych przez zewnętrznych fact-checkerów na rzecz notatek społeczności, czyli rozwiązania wdrożonego już na X.com przez Elona Muska.

W kilkuminutowym wideo na Facebooku, Mark Zuckerberg przekonywał, iż zmiana ta ma na celu ograniczenie błędów w moderacji i w niewłaściwym oznaczaniu publikowanych treści jako fałszywe – co przez wielu użytkowników określane było jako ich cenzurowanie. Ponadto zmiany w moderacji mają spowodować uproszczenie zasad panujących w mediach społecznościowych należących do platformy i przywrócenie na nich wolności słowa.

Brzmi to przekonująco – z jednej strony przyznanie się do błędów i cenzurowania treści – a z drugiej przyznanie społeczności istotnego wpływu na interpretację pojęcia „wolność słowa” przez samodzielną ocenę i dodawanie kontekstu do publikowanych treści na platformach Mety.

Co to dokładnie oznacza? Jeśli chodzi o dalszy udział Facebooka w moderowaniu treści, ten będzie odznaczał się złagodzeniem ograniczeń dotyczących niektórych tematów, takich jak imigracja i tożsamość płciowa oraz bardziej neutralnym podejściem w kwestiach politycznych i społecznych.

Skupi się za to bardziej na sprawdzaniu naruszeń prawa, takich jak terroryzm, wykorzystywanie seksualne dzieci, narkotyki, oszustwa i przekręty – na przykład znane i uciążliwe w polskiej części Facebooka reklamy fałszywych inwestycji oraz wyłudzających dane do logowania.

Z kolei społeczności oddana zostanie opcja dodawania kontekstu do publikowanych treści, dzięki czemu użytkownicy będą mogli oznaczać je jako podejrzane, a jeśli wystarczająco dużo osób zgodzi się z taką oceną, notatka będzie widoczna dla wszystkich.

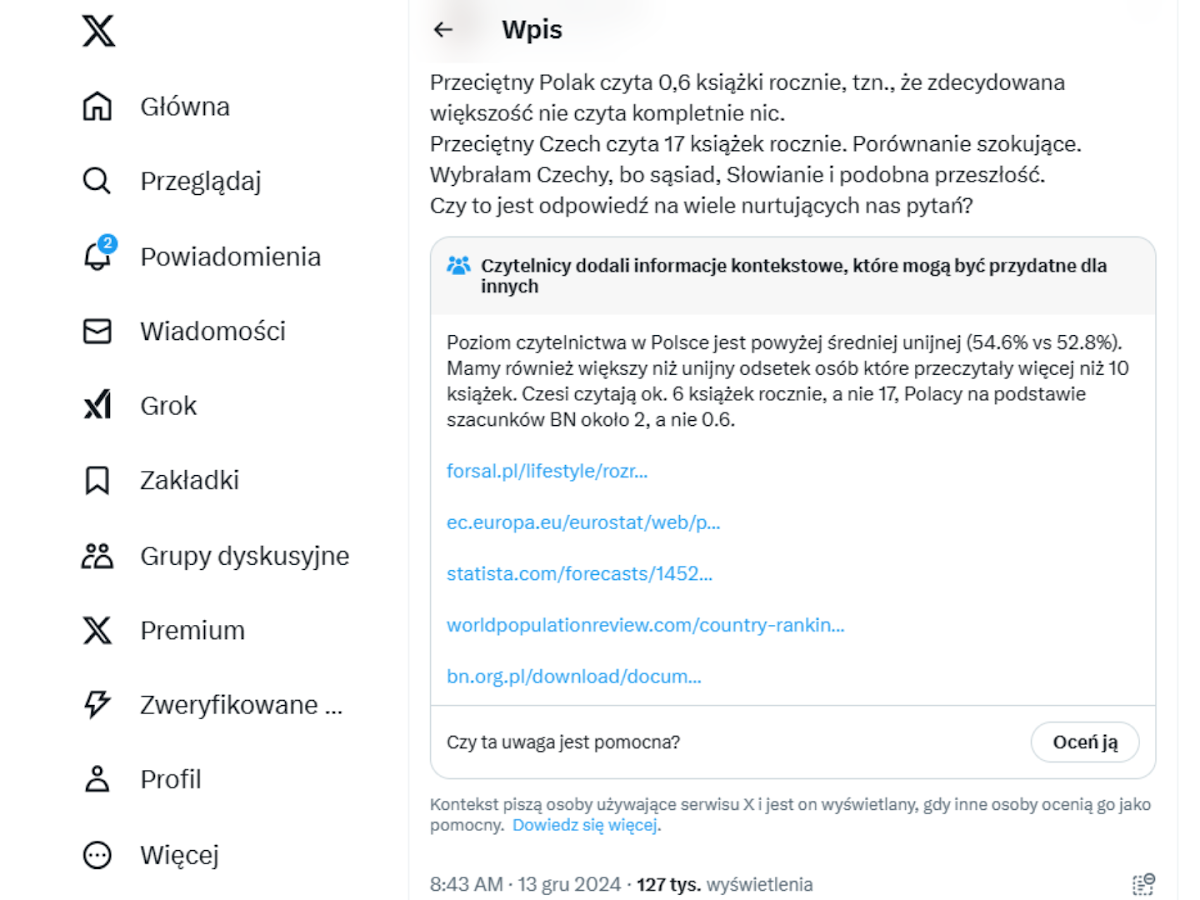

Jak to dokładnie działa? Wystarczy spojrzeć na podobne rozwiązanie, zastosowane na platformie Elona Muska – X.com.

Jeśli ktoś opublikuje kontrowersyjną treść, a wystarczająca liczba osób zgłosi ją jako przekłamanie oraz poprze to wiarygodnymi informacjami – taka notatka (kontekst) pojawia się bezpośrednio pod takim wpisem.

Wydaje się to bardzo dobrym rozwiązaniem, z zaobserwowanych tak oznaczonych postów czy choćby powyższy przykład pokazuje, że działa to świetnie. Łatwo sobie wyobrazić, że ten i jemu podobne miliony innych postów nie zaprzątałyby głowy fact-checkerom. Natomiast sama społeczność doskonale je wychwytuje, wzbogacając je o rzeczowe i prawdziwe informacje.

Oczywiście, to zadziała tylko jako dodatkowe (wspomagające) rozwiązanie w całości moderacji, z której mam nadzieje nie zrezygnuje zupełnie platforma Meta, a jedynie zadba o zrównoważenie ochrony przed szkodliwymi treściami a zapewnieniem swobody wypowiedzi użytkowników.

To jak i czy zmiany te wpłyną na walkę z dezinformacją pokażą najbliższe miesiące, kiedy to Meta planuje stopniowo je wdrażać w swoich serwisach. Na szczęście nie są to nieodwracalne zmiany, więc jak nie spowodują zakładanych pozytywnych skutków, na bieżąco będzie można je przecież modyfikować.

Skontaktuj się z Działem Rekrutacji, aby otrzymać odpowiedzi na wszystkie swoje pytania.

rekrutacja@pja.edu.pl